Voy a comentar algunas ideas de la filosofía de la tecnología de Günther Anders, y voy a utilizarla como prisma para analizar algunos aspectos de la IA, que para eso valen los filósofos, para usarlos como instrumentos de observación del presente.

Günther Anders fue un filósofo polaco muy preocupado por la destrucción del mundo en los tiempos de la Guerra Fría, fue un tenaz pacifista y activista contra el desarrollo de bombas atómicas. Mantuvo una correspondencia con el norteamericano Claude Eatherly (piloto del avión de reconocimiento climático que seleccionó el objetivo al Enola Gay en el lanzamiento de la bomba sobre Hiroshima) que publicó en una obra titulada Burning conscience de 1961, lo que le valió a Anders ser considerado un comunista y una persona non grata en Estados Unidos. Y es que Eatherly sentía una culpabilidad tan grande por su colaboración en Hiroshima que se dedicó a cometer delitos para que lo ingresaran en prisión y así expiar de algún modo su culpa. Esa actitud le valió pasar buena parte de su vida entre la prisión y el manicomio para veteranos de Waco, y a ser considerado una figura incómoda, como todo pacifista, para el clásico belicismo institucional yankee. Hoy lo tacharían de woke.

Anders publicó su obra más importante, La obsolescencia del hombre, en dos tomos con más de veinte años de distancia el uno del otro: 1956 y 1980. En ella desarrolla una interesante idea: el desfase prometeico. Podría resumirse en que vivimos en una época en la que nuestra capacidad de producción tecnológica supera con creces a nuestras capacidades de comprender, imaginar, sentir o asumir éticamente sus consecuencias. Hemos perdido la capacidad de controlar y siquiera de representar simbólicamente nuestro desarrollo tecnológico. Por esa razón Eatherly no podía asumir lo que había hecho. La bomba atómica es algo tan atroz, representa un desfase prometeico tan grande, que nadie puede asumir la responsabilidad por algo así. Desborda toda categoría moral.

Según Anders, uno de los rasgos del desfase prometeico es que la tecnología moderna ha comenzado a progresar según su propia lógica interna, con total independencia de nuestras necesidades éticas y políticas. Aplicando esta idea a nuestro presente más inmediato, estamos teniendo el caso de que muchos de los responsables de las grandes tecnológicas de inteligencia artificial nos dicen que ésta es muy peligrosa, incluso un riesgo existencial para la humanidad, a la vez que mantienen una tenaz «carrera armamentística» por estar a la cabeza de su desarrollo. Todos pusimos una mueca irónica cuando Elon Musk firmaba la famosa carta en la que pedía una moratoria de seis meses en el avance de la IA, a la vez que se apresuraba a crear Grok. Da la impresión de que todo el mundo está muy asustado y nadie sabe qué va a pasar, a la vez que la IA avanza por sí sola a un ritmo cada vez más rápido, como si los seres humanos no pudiésemos hacer nada al respecto, como si una fuerza extrahumana, sobrenatural, estuviera impulsando el advenimiento de la lovecraftiana super inteligencia.

Yo, siempre he estado en contra de esta idea, que no es más que el clásico determinismo tecnológico. Creo que decir que la tecnología evoluciona con una lógica interna independiente del ser humano es una forma burda, tanto de exonerar a los responsables del desarrollo tecnológico de su responsabilidad, como de paralizar todo intento de detener cualquier tecnología perniciosa ¡Claro que el ser humano tiene que ver con el desarrollo tecnológico! ¡Y claro que el ser humano puede parar el desarrollo de tal o cual tecnología! Entonces, ¿por qué no lo hace? En el caso de la IA hay dos razones fundamentales: primera, la pura y dura codicia, tanto por el rédito económico como por el reconocimiento social. Fue un tanto vergonzosa la visita de Sam Altman a una Europa en la que sus autoridades lo recibieron como un mesías, cuando más bien habría que haberle tirado bastante de las orejas. Y segunda, que no llegan a creerse que la IA sea tan peligrosa o que, en el caso de que los riesgos se disparen, creen que ellos mismos van a ser capaces de sortearlos. Es una estrategia política muy vieja crear un problema a la vez que te vendes como el único capaz de solucionarlo.

Así que lo que hay que hacer es no creerse tanta patraña, plantar cara y pelear por un uso más ético y beneficioso de la IA. Detrás de toda tecnología hay personas con diferentes cuotas de responsabilidad a los que hay que pedir cuentas. Por ejemplo, estos días hemos visto una progresiva ruptura con la promesa de no utilizar la IA para uso militar por parte de las bigtechs. En este mismo mes de julio, OpenAI, Google, Anthropic y xAI, han firmado contratos de hasta doscientos millones de dólares cada uno, para fomentar las capacidades de IA en el Departamento de Defensa de Estados Unidos. Y sí, desgraciadamente para estos tipos, ser diseñador de armas que se usan para matar, aunque sean otros los que las usen (incluyendo agentes de IA autónomos), no te libra de tu parte de responsabilidad. Todos los físicos que participaron en el Proyecto Manhattan sabiendo lo que hacían tienen cuota de responsabilidad en Hiroshima.

Sin embargo, sí que creo que la tesis de Anders es cierta en un sentido. Si el control de la IA está en manos de media docena de empresas cuyo poder está por encima de las instituciones políticas y democráticas, sí que hemos perdido el control sobre ella. Quizá sea un rasgo del capitalismo tardío, postcapitalismo o como queramos llamarlo, el hecho de que el desarrollo tecnológico se escape por completo a cualquier control institucional. Creo que nunca antes se había atesorado tanto poder en unas pocas empresas, y eso es realmente peligroso porque, sin control político, solo nos queda confiar en que sean buenos chicos (recordemos el «Don’t be evil» como lema de Google). Es como en la monarquías medievales y absolutas. El pobre vasallo debía confiar en que su señor sería buena gente, porque no existía herramienta jurídica para echarlo si no lo era. Por eso la etiqueta de tecnofeudalismo de la que habla Varoufakis entre otros, no va demasiado desencaminada a la hora de designar en lo que se está convirtiendo nuestro sistema.

Pero además, siguiendo a Anders, si nuestra tecnología ha desbordado por completo nuestra capacidad de comprensión y, por tanto, de predicción, como parece estar pasando en el campo de la IA, no existe nadie competente para tratar con este tema. En palabras del propio Anders, «Lo que significa que, en este campo, nadie es competente y que el apocalipsis está por tanto, por esencia, en manos de los incompetentes». Yo no soy tan apocalíptico con respecto a la IA, he escrito ya muchísimas veces contra esta idea; pero sí que creo que la IA va a traer, y está ya trayendo, muchísimos problemas y que los responsables no lo están haciendo, hasta ahora, demasiado bien. Y la causa no es que sean malvados, sino, simplemente, que no saben cómo hacerlo bien. Resumiendo: tenemos que confiar en que gente que no ha mostrado un comportamiento con unos altos estándares éticos, ahora sí lo muestre, y en que, además, sea competente en un campo en el que, por definición, no es posible… ¿Qué puede salir mal?

Anders subraya otra idea interesante: la desconexión directa con las consecuencias de nuestras creaciones tecnológicas. Si yo soy un técnico de la General Atomics, y en California ensamblo piezas de un dron de combate Mk-1 Predator, nunca veré al producto de mi trabajo lanzar misiles sobre guerrilleros hutíes en Yemen. Es muy probable que no tenga ni idea ni dónde ni contra quién va a usarse. Esa distancia produce indiferencia moral. Si ni conozco, ni siquiera veo ni tengo casi noticia, de las víctimas de los misiles de mi dron, no me siento nada responsable de su suerte. Cuando las consecuencias de una acción ocurren en un lugar lejano y poco definido, cuanto menos concreto y más abstracto sea, menos me sentiré responsable de ello. Y es que estamos programados para que nos importen los que están cerca, los nuestros, los que se parecen a nosotros; y al contrario, a sospechar del raro, del diferente, del extranjero. En mis clases suelo hacerles a mis alumnos esta pregunta: ¿A quién salvarías antes de ser asesinado? ¿A tu perro o a mil personas en Sudán del Sur? La respuesta es siempre casi unánime: a la mascota. Esto nos lleva a una compleja diatriba: ¿cómo conseguimos entonces tener un comportamiento ético con personas que no nos importan? ¿Cómo vamos a ayudar a la gente de Sudán del Sur si nos importan mucho menos que nuestro perro? Mi solución es que hay que ser más kantianos: ayudamos a la gente de Sudán del Sur no porque nos importe en absoluto, sino porque debemos hacerlo. Hay que hacer lo correcto con independencia de lo que nos haga sentir.

Sin embargo, siguiendo la lógica de Anders, el desfase prometeico de la tecnología contemporánea favorece esta indiferencia moral y emocional. Si eres un neandertal y fabricas un bifaz que usas para matar a otro, recibes todo el impacto moral de tu acción: no hay desconexión entre fabricación y uso de la herramienta, tú mismo ejecutas la acción y contemplas el rostro de tu víctima mientras muere (recordemos «la mirada del otro» de Emmanuel Lévinas). Has sido plenamente consciente de todo el daño causado por tu acción. Por el contrario, el técnico del Mk-1 Predator termina la jornada laboral y se va muy feliz con su familia a cenar unos tacos de pescado y unos burritos californianos. Es más difícil ser kantiano en la distancia, en la desinformación, en el olvido.

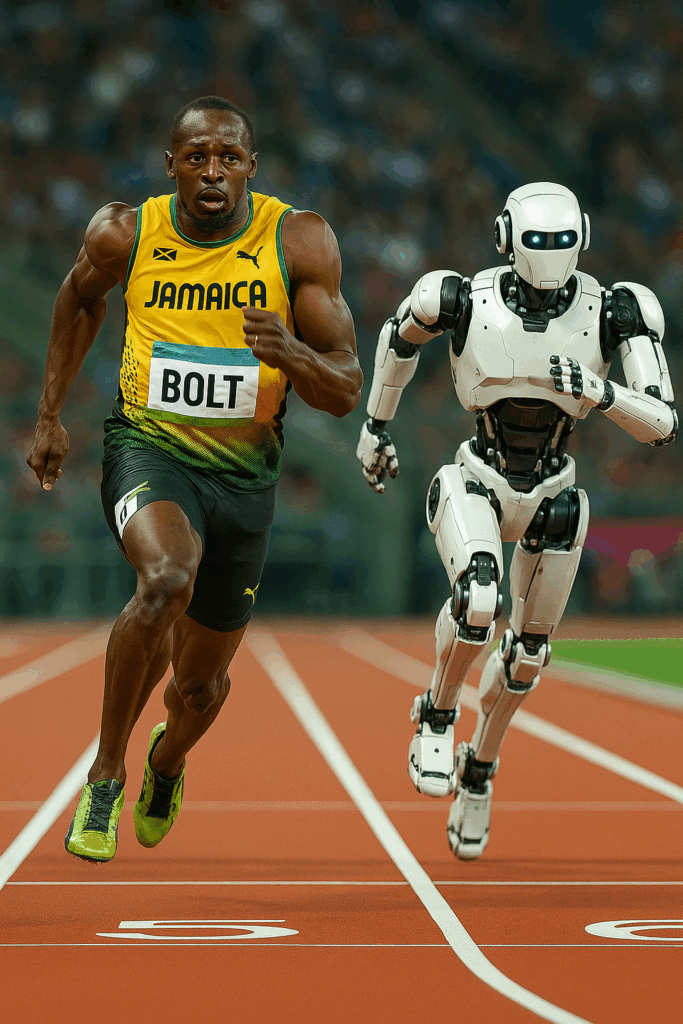

Otro concepto interesante de Anders ligado al desfase prometeico es el de la «vergüenza prometeica»: el sentimiento que siente el hombre al verse superado por su creación. Es lo que sintió Kasparov al ser derrotado por Deep Blue, o Le Sedol al perder contra AlphaGo. Si las máquinas nos superan, ¿qué nos quedará por hacer? El ser humano quedará obsoleto, expulsado de su protagonismo como sujeto de la historia ¿Por qué pintar un cuadro si una IA lo puede hacer infinitamente más rápido y mejor? ¿Por qué escribir una poesía si una IA puede generar miles en lo que tardas en coger el lápiz? ¿Cómo se enfrentará el orgulloso ser humano a esa vergüenza, a esa inferioridad? ¿La aceptará sin más y se dedicará al ocio y al bienestar que la IA podrá otorgarle? ¿O se enfrentará a su creación en un brote ludita? No obstante, aquí de nuevo estoy en cierto desacuerdo con Anders. En primer lugar, creo que el momento en el que las máquinas nos superen y nos hagan sentir esa vergüenza aún no ha llegado , y está mucho más lejos de llegar de lo que piensan muchos (No sé el lector, pero yo no me siento nada inferior a ChatGPT) . Y en segundo, creo más en que la IA va a ir avanzando mucho más como herramienta que como sustituto. El ser humano no va a quedar obsoleto tan aprisa. Y, en cualquier caso, creo que las consecuencias no serían tan graves. Un automóvil corre mucho más rápido que Usain Bolt y eso no ha quitado un ápice del reconocimiento por los logros del atleta; tenemos grúas capaces de levantar miles de toneladas y eso no hizo que no nos quedásemos boquiabiertos cuando Hafþór Júlíus Björnsson batió el récord de levantamiento de peso muerto este mismo año, con 505 kilogramos; en ajedrez, las máquinas nos machacan inmisericordemente desde hace muchas décadas y eso no quita nada de la admiración que sentimos hacia Magnus Carlsen. Son muchísimos los ejemplos en los que las máquinas lo hacen mejor que nosotros y las consecuencias no han sido emocionalmente tan drásticas como supone Anders. Yo, la verdad, uso la calculadora de mi móvil para dividir la cuenta del restaurante, sin sentir demasiada vergüenza prometeica porque su capacidad de cálculo sea muy superior a la mía.

Bien, ¿y cuál es la solución que propone Anders ante este colapso moral? Algo bastante obvio: una ética de la anticipación. Hay que recuperar o reforzar nuestra capacidad de imaginar las consecuencias de nuestras producciones tecnológicas. No puede ser esperar al horror para tomar medidas después: hay que anticiparse. Esta tesis me recuerda a, probablemente, la mejor idea que ha dado un pensador español a la historia de la filosofía en los últimos tiempos: el concepto de eficiencia tecnológica de Miguel Ángel Quintanilla. Un artefacto es eficiente sí, y solo sí, utiliza las medios más económicos para llegar a sus objetivos, y nada más que a sus objetivos. Dicho en otras palabras, para construir una máquina eficiente debemos ser capaces de predecir todos los efectos no deseados inicialmente que pueda producir. El reto: es sumamente difícil, si no imposible, predecir todos los efectos secundarios que tendrá una tecnología, más cuando evoluciona en el tiempo y en un entorno cambiante. No obstante, que sea complicado no quiere decir que no sea lo que hay que hacer; más viendo que hoy se lanzan artefactos al mercado sin el más mínimo estudio de impacto. Pensemos, muy seriamente, en los LLMs: cajas negras lanzadas al gran público… ¡Y ahora con funciones de agente!

Anders sostiene que hay que deshacerse de la funesta «Si algo puede hacerse, debe hacerse». Hay que rehumanizar la tecnología y devolver la centralidad a la ética en las decisiones tecnológicas. Hay que reforzar el papel de la política y de la deliberación democrática en la toma de decisiones de programas de desarrollo tecnológico que tienen consecuencias en las vidas de todos. Volvemos a recordar el gran problema que supone que media docena de empresas controlen la IA mundial, muy por encima de cualquier poder institucional.

Post data: si os ha interesado este artículo, podéis matricularos en el máster en Ética Digital de UTAMED, donde voy a impartir dos asignaturas, una de fundamentos filosóficos de la IA, y otra de Ética para perfiles técnicos. Perdonadme por la autopublicidad.

Post data: la filosofía de Anders me parece muy en sintonía con las fastuosas obras de Benjamín Labatut Un verdor terrible y Maniac. Son dos novelas que recomiendo muchísimo. Y, por supuesto, con la Oppenheimer de Nolan.

Subscribo punto por punto, y, sí, para textos como este suyo está la filosofía. Mírate, si acaso también, el concepto de “punto arqumédico” en la obra de la ex de Anders, ya sabes quien.