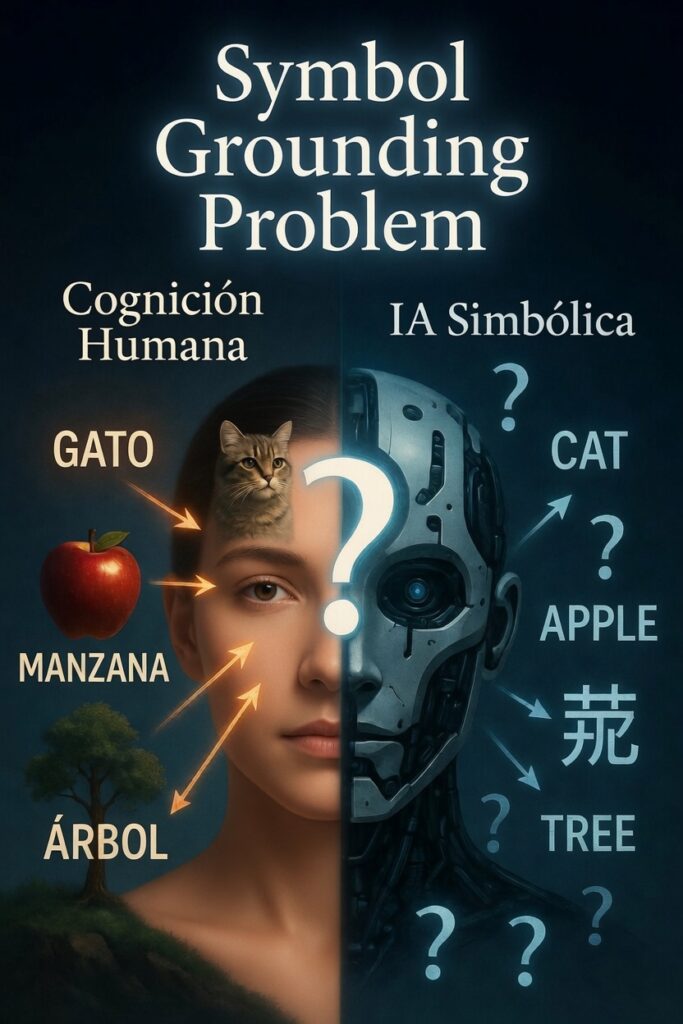

Hoy vamos a comentar un artículo, a mi juicio muy interesante, para afrontar el actual debate sobre si los LLMs tienen genuina comprensión de la realidad: «The vector Grounding Problem» de Dimitri Coelho y Raphaël Millière. En él se actualiza el célebre argumento del symbol grounding problem, propuesto por Steven Harnad allá por los años noventa del ya lejano siglo pasado.

La cuestión es la siguiente: Si los LLMs no tienen contacto directo con la realidad, ¿cómo saben qué significan las cosas? Un ordenador es un procesador que, en último término, realiza computaciones en unidades discretas de información (bits), que pueden entenderse como símbolos (como cosas que están en lugar de otras cosas, que simbolizan otras cosas. Así un determinado voltaje simboliza un 1 y su ausencia un 0). Esas computaciones se realizan siguiendo reglas que podríamos denominar sintácticas (cambia este bit de sitio en el registro, borra este otro…). Entonces, ¿cómo de esa pura sintaxis puede surgir semántica? ¿Cómo puede surgir genuina comprensión? Harnad ya lo ejemplificó de una forma muy ilustrativa mediante el ejemplo del diccionario chino-chino: supongamos que le damos a una IA un diccionario chino-chino, es decir, un diccionario de definiciones escrito en chino (una enciclopedia de toda la vida de las que antes teníamos en los anaqueles de la estantería del salón). ¿Podría la IA comprender chino únicamente con ese diccionario, sin más contacto con el mundo? Según Harnad no, porque cada cadena de símbolos en chino le remitiría a otra cadena y así sucesivamente, quedando la IA encerrada en una especie de prisión simbólica circular. Por ejemplo, si la IA quisiera entender qué significa la palabra «狗» (perro), en la correspondiente entrada del diccionario le pondría «犬科家養哺乳動物» (Mamífero doméstico de la familia de los cánidos), por lo que para saber lo que es «狗» ahora tendría que descifrar qué significan cada una de los extrañas grafías chinas de la definción, lo que, a su vez le llevaría a nuevos símbolos a descifrar en una sucesión ad infinitum. Necesariamente, para comprender el mundo habría que tener acceso a él, habría que tener acceso a los referentes de los significados. La IA solo sabría qué es un perro si asocia la palabra con la imagen de un perro real.

Objeción: los LLMs podrán estár encerrados en esa prisión simbólica, pero nos responden con un espectacular manejo de la semántica. Si charlas un rato con ChatGPT, pronto te das cuenta de que, sin saber de alguna manera lo que significan las palabras, no podría responderte con semejante competencia lingüística. ¿Cómo no va a poseer semántica un sistema capaz de solucionar problemas del FrontierMath? Entonces, si tenemos rotunda evidencia de que la IA maneja semántica, el planteamiento de Harnad tiene que ser erróneo.

Respuesta: es que los LLMs tienen semántica porque han sido entrenados con millones de textos escritos por seres humanos que sí tenían semántica, que sí tenían comprensión genuina de la realidad. Por tanto, la IA tiene lo que Searle llamaba intencionalidad derivada, lo que en el artículo los autores llaman semántica extrínseca y lo que yo he llamado algunas veces como semántica prestada. La gran pregunta que se hacen Coelho y Millière en el artículo es: ¿Pueden los vectores internos de los LLMs tener semántica intrínseca? O dicho más claramente: ¿Pueden los LLMs comprender el significado de algo, independientemente de que un intérprete externo (como un humano) se lo atribuya?

Primero expliquemos en qué sentido hablamos aquí de vectores. Los LLMs almacenan su conocimiento semántico en vectores, es decir, en largas cadenas numéricas. ¿Y cómo puede almacenarse semántica en cadenas numéricas? Utilizando embeddings dinámicos mediante arquitecturas transformer. Lo explico de forma muy sucinta: se entrena a una red neuronal artificial mediante millones de textos y lo que se le pide como resultado es que realice predicciones estadísticas de cuál es la siguiente palabra o token que «quedaría bien», dado un texto de entrada o prompt. Para conseguir eso las palabras o tokens se traducen en largos vectores situados en un gigantesco espacio multidimensional. Cuando el sistema ha sido entrenado, el significado de cada palabra es un patrón de relaciones con las demás palabras dentro de ese espacio. Además, afinando un poquito más, no hay un vector por palabra, sino que, dependiendo del contexto en el que se encuentre aquella, podrá ser «representada» por más de uno. Para un LLMs los conceptos no son puntos en el espacio, sino más bien regiones en donde se tejen relaciones. Por poner un buen símil dentro de la filosofía del lenguaje, podrían parecerse a los juegos de lenguaje de Wittgenstein. Por ejemplo, la palabra «perro» no sería un único vector, sino una nube de vectores en distintos contextos: «El perro ladra», «Raza de perro» o «Comida para perros». Pero, y dejemos esto claro, los significados nunca dependen de ninguna conexión directa con el mundo (con ningún grounding), sino de las relaciones entre expresiones (lo que, dicho sea de paso, recuerda a la concepción del lenguaje de Quine): el diccionario prisión circular de Harnad parece cumplirse claramente.

¿Cómo salimos de esta cárcel simbólica? En el artículo, Coelho y Millière (C&M a partir de ahora) distinguen varios tipos de groundings (sensorimotor, relacional, comunicativo y epistémico), pero subrayan que, en el fondo, todos ellos nos llevan únicamente a conectar representaciones con otras representaciones, es decir, no consiguen salir de la prisión, no logran conectar con el mundo real. Así, el único grounding que aceptan es el clásico, el referencial: la conexión directa con la realidad. Y los autores van a defender que, a pesar de nuestras primeras impresiones, los LLMs podrían conseguirlo.

C&M defienden que para que se dé ese «enganche», ese significado intrínseco, hacen falta dos condiciones:

(1) Relaciones causales informacionales: el estado interno debe informar sobre algo del mundo.

(2) Relaciones históricas/funcionales: el estado interno debe haber sido seleccionado para cumplir esa función informativa. Debe poder entonces tanto acertar como fallar . C&M van a ofrecer aquí una interesante distinción:

Función próxima: cuando el objetivo de la representación es solo predecir el siguiente token.

Función final: cuando el objetivo de la representación es producir respuestas útiles, verdaderas, coherentes con el mundo. Obviamente, solo cuando hay función final hay verdadero grounding referencial.

¿Cumplen esas condiciones? C&M parten de la semántica extrínseca para llegar a la intrínseca. Como hemos dicho, los textos que los LLMs utilizan para su entrenamiento han sido escritos por personas con semántica intrínseca. Entonces, el corpus de entrenamiento contiene huellas del mundo. En los textos hay patrones lingüísticos que reflejan la estructura del mundo. Por ejemplo, si en un texto tenemos que «El fuego calienta objetos» y luego le decimos a la máquina «Al lado del fuego había una roca. Juan cogió la roca ¿Juan se quemó?», y ésta responde correctamente, habrá captado una regularidad del mundo. Cada vez que una IA aprende a generalizar está encontrando una relación que no es puramente lingüística. De hecho, mucho del conocimiento que tenemos los seres humanos es así: aprendemos porque otros nos lo dicen, no porque contactemos directamente con el mundo. Yo he aprendido que el Everest mide 8,849 metros porque me lo enseñaron en las clases de geografía del colegio, no porque haya ido al Himalaya. Gran parte de nuestro conocimiento es fundamentalmente lingüístico, es semántica prestada por otros. Pero con esa semántica puedo comprender y crear nueva semántica. Por ejemplo, si me muestran las alturas del Everest y del Mont Blanc, puedo deducir que el Everest es más alto. Y así funcionan los LLMs.

Pero para los autores esto todavía es insuficiente. Ya sabemos que la correlación no implica causalidad, no siempre representa. Hace falta la condición (2): función final. C&M hablan que en el post-training del modelo, cuando se usan técnicas como el RLHF (Reinforcement Learning from Human Feedback), es decir, cuando se usan humanos para entrenar al LLM con fines, por ejemplo, de alineamiento ético, se le introducen criterios normativos del mundo real, tales como la verdad, la utilidad o la seguridad. En este tipo de entrenamiento se premia a los LLMs por dar respuestas correctas sobre el mundo y no solo plausibles lingüísticamente hablando. Se seleccionan representaciones internas porque permiten rastrear estados del mundo y generar respuestas verdaderas. Y no hace falta irse al fine-tuning. C&M sostienen que con el simple preentrenamiento también pueden darse las dos condiciones en algunos casos. Ponen el ejemplo de Othello-GPT, un programa entrenado para jugar al Othello solo viendo jugadas, sin haber «visto» nunca explícitamente un tablero, pero que necesariamente tiene que tener alguna representación interna de él para poder desempeñar ese nivel de juego (Adjunto el interesante artículo que citan). Es decir, los LLMs pueden crear estructuras internas para realizar ciertas tareas que pueden cumplir las dos condiciones de la semántica intrínseca. No obstante, aquí los autores se muestran más prudentes y reconocen que puede verse con claridad en el caso de los juegos, pero que en el lenguaje el asunto se torna mucho más difuso.

Conclusiones finales del artículo: Algunos tipos de modelos de IA generativa desarrollan una forma limitada grounding referencial porque sus representaciones internas son moldeadas por datos lingüísticos que reflejan patrones o estructuras de la realidad, y por procesos de entrenamiento que seleccionan estados capaces de rastrear ese mundo bajo criterios de éxito como la verdad. Eso no quiere decir que tengan genuina comprensión, tengan creencias, mente o, mucho menos, consciencia. Simplemente, podría decirse que han cruzado el umbral del significado. Si bien no parece adecuado atribuirles comprensión en un sentido maximalista, tampoco parece adecuado negarles toda, o negársela en todos los sentidos. Y, en cualquier caso, lo que me parece profundamente interesante es que artículos como éste nos obligan a girar el foco y apuntarlo hacia nosotros mismos: ¿Qué es comprensión en un humano? ¿Qué hay en nuestra comprensión de los significados que no tienen las máquinas? Porque, habitualmente, somos muy rápidos elaborando la crítica y defendiendo que lo que hace la IA no es genuina comprensión, pero esa seguridad se torna en balbuceos cuando nos miramos el ombligo: ¿Es que acaso sabes definir comprensión en humanos?

Conclusión provocativa: para C&M ni los modelos multimodales ni los encarnados suponen avance alguno para el anclaje ¿Por qué? Porque añadir imágenes o sonidos es, simplemente, añadir nuevas representaciones que no tienen porqué cumplir las condiciones. Podríamos tener percepciones sin representación o correlaciones sensoriales sin función, es decir, el anclaje no tiene que ver con el tipo de representación, sino con su función. Yo incidiría, porque los autores creo que no lo hacen suficiente, en la idea de que cualquier modalidad sensorial siempre se traduce a lenguaje. Para un LLM una fotografía no deja de ser una matriz numérica sobre la que se van a realizar computaciones. Una imagen no se trata de una forma esencialmente diferente a cualquier otro tipo de información lingüística. La multimodalidad sensorial no nos libera de la cárcel de Harnad.