En las actuales ciencias cognitivas, el concepto de información se ha postulado como central para comprender el funcionamiento de la mente. Muchos afirman rotundamente que la mente es un sistema universal de símbolos, es decir, una máquina que transmite, manipula, modifica información. Tal tesis quedó avalada por el descubrimiento fundacional de las neurociencias: la neurona, una célula cuya primordial misión parece ser la de transmitir información. Además, parece hacerlo de modo relativamente simple, mediante un sistema sumatorio de pesos que hace que una neurona se dispare o no en función de los estímulos recibidos por otras neuronas (la grandísima aportación de Hebb). Además, debido a la plasticidad cerebral, las asambleas de neuronas pueden aprender. En los modelos matemáticos que tenemos de ellas el aprendizaje es arduo y costoso, pero, a la postre eficaz. Podemos entrenar estas agrupaciones de células simples para que hagan un montón de cosas y, a pesar de la dura crítica de Papert y Minsky que dejó está vía de investigación paralizada durante años, hoy ha renacido con fuerza consiguiendo algunos notables resultados.

La idea parece muy buena. Los pioneros de la Inteligencia Artificial pensaban que la mente era algo así como el software de nuestro cerebro, de modo que lo que había que encontrar era ese programa maestro que emulara perfectamente a la mente humana. Pero, pensándolo bien, el cerebro no parece tener un programa que funcione a modo del Prolog o del Lisp (aunque muchos así lo siguen defendiendo: es el popular mentalés). Parecía más lógico empezar por debajo: en vez de construir el software, hagamos el hardware y veremos lo que pasa. Así, basándose en estudios del sistema nervioso, se construían modelos matemáticos y se comprobaba que podían hacer. Es el clásico programa conexionista.

Los modelos de redes neuronales siguen avanzando y, de momento, son lo más parecido que tenemos a cómo los cien mil millones de neuronas que contiene nuestro cerebro, pueden hacer que tengamos vida mental. En este vídeo vemos un pequeño ejemplo de un robot diseñado por Pentti Haikonen a partir de su famosa arquitectura.

El robot detecta la dirección de la fuente de sonido y se acerca a ella. Todo lo hace sin ningún tipo de programa (nada de if, for, case, class, main…) ni realizando ningún cálculo. Simplemente sigue los patrones de una red de neuronas: puro cableado que muestra una notable similitud con lo que parecen ver los neurólogos al cartografiar nuestro cerebro. Es posible que, realmente, nuestro sentido auditivo pueda funcionar así. Es un gran logro y una magnífica vía de investigación que, sin duda, dará un montón de frutos.

Sin embargo (mi famoso sin embargo con el que empiezo el 90% de mis argumentaciones) hay un problema muy grande. Para ciertos procesos mentales el modelo de Haikonen parece muy apropiado, pero sólo para ciertos procesos mentales. ¿Cuáles? A saber, los inconscientes. Porque un sistema basado únicamente en el concepto de información no puede dar constancia de nuestros estados mentales conscientes. Razonemos:

1. He leído mucho acerca del concepto de información, incluso libros dedicados en exclusiva a ese concepto, y no he encontrado una definición satisfactoria. En muchos casos he encontrado una definición matemática (I=1/logp), la cual relaciona la información que disponemos de un suceso con su probabilidad. Está muy bien, y da para pensar un montón, pero no nos dice realmente qué es la información. Un ejemplo muy ilustrativo al respecto es el siguiente: supongamos que tenemos varios medios para codificar una información: una cinta de cassette, un disco de vinilo y un CD. En ambos está guardada la misma canción. Los tres medios están compuestos de materiales diferentes: la cinta de cassette es de plástico unida a diferentes materiales magnéticos que graban la información de forma mecánica y analógica; el disco de vinilo graba la información en surcos en su superficie; y el CD está hecho de policarbonato y aluminio grabando la información de modo digital. Tres materiales diferentes que, maravillosamente, nos dan el mismo resultado: escuchar la misma canción. ¿Qué es lo que tienen en común estos tres objetos hechos de materiales diferentes y estructurados de distinta forma? La información que guardan. Vale pero, ¿qué es exactamente eso que los tres guardan por igual? Vergonzoso silencio.

2. La información sólo tiene sentido en la medida que informa a algo o a alguien. La información es simbólica, refiere a algo, da como resultado algo que no es ella misma, tiene necesariamente una función dentro de un todo más grande. Por ejemplo, en un termostato que activa la calefacción cuando la temperatura baja a 10ºC, cuando el termómetro llega a tal temperatura informa a la caldera para que se active. Su único sentido es activar la caldera. Sin calefacción, el termómetro del termostato sólo es una barra de mercurio que se contrae o se dilata, un objeto sin sentido informativo alguno. Dicho de otro modo: la información no es nada, no es un “objeto” de la naturaleza si no existe un sujeto que la utilice. La naturaleza, sin seres vivos o máquinas que traten la información, está desinformada, no contiene información alguna, porque la información no es una propiedad objetiva, sino subjetiva.

3. Entonces, y aquí viene lo importante, la mente no puede ser sólo flujo de información, ya que esa información tiene sentido sólo si informa a algo o a alguien. En la máquina de Haikonen, la información que pasa por los cables tiene sentido en la medida en que activa los motores del robot. La información sólo es información cuando causa cosas. A fortiori, el cerebro sí que puede contener flujos de información, pero eso no es lo esencial en ella: lo esencial es que produce pensamientos, emociones, recuerdos, etc. La información puede activar cierto estado mental, pero no puede ser ese estado mental. Al igual que en el robot de Haikonen, la información causa que el robot se mueva, pero el movimiento no es información.

4. Conclusión: que el cerebro contenga un montón de información y que esa información fluya a raudales por sus fibras nerviosas no nos dice nada de la naturaleza de los estados mentales. O, como mucho, sólo nos dice una pequeña parte de la historia. Si entendemos el proceso en términos de entrada y salida, un input (información) como ver al ministro de educación, estimula mis neuronas y hace que la información fluya por ellas para producir un output (resultado que no es información) como puede ser un ataque de pánico (estado mental). La información informa a “alguna parte de mi cerebro” para que ésta produzca, de una manera totalmente desconocida a día de hoy por la ciencia, un estado mental (que ya no es información, sólo es una sensación consciente).

5. Estudiar la mente en términos de la teoría de la información puede dar grandes resultados y, a mi juicio, ha sido uno de los grandes descubrimientos del siglo XX, pero no puede ser toda la historia. Lo importante es saber cómo esa información produce estados mentales. Debe existir algún tipo de mecanismo o proceso físico o biológico desconocido aún que produzca sensaciones, que haga que yo tenga miedo o que piense en mi abuela. Y eso no puede ser un conjunto de neuronas que únicamente se transmitan información unas a otras porque la información no es nada si no hace algo. Descubrir qué es ese algo debe ser la línea fundamental de investigación si queremos saber de una vez por todas cómo funciona la mente.

Creo que estamos informadísimos, pero de otra manera:

http://www.culturamas.es/blog/2012/02/27/la-falacia-de-los-cinco-sentidos/

A mi me preocupa el desarrollo de inteligencia sin conciencia, es decir, cada vez es más frecuente encontrar aplicaciones que te escucha y te dan una respuesta, por ejemplo: solicitar una dirección, buscar el significado de una palabra, resolver una operación matemática, llevar la agenda, recordatorios, etc. Sin embargo, la aplicación no está consciente de lo que hace. La tecnología logra hacer cada vez más cosas, y nosotros deleguemos en esa tecnología. Si la conciencia propia es complicada, la conciencia en cuanto al otro debe ser más. Y sin conciencia del otro no me puedo imaginar la empatía. En el ser humano, un individuo inteligente, capaz de lograr sus objetivos, sin empatía y sin moral (ya que no tiene conciencia de ello o no le importa) es un alto candidato a ser psicópata. Por eso me preocupa el avance de la inteligencia artificial sin conciencia, porque ¿cómo dar garantía del cumplimiento de las leyes de la robótica de Asimov?

Óscar:

Creo que vivimos en antípodas filosóficas inconmensurables. Una cosa es que el paradigma computacional tenga deficiencias en su planteamiento y otra, muy distinta, negar lo que sabemos sobre el funcionamiento de los cinco sentidos. Sabemos con bastante certeza como, por ejemplo, el ojo, codifica las ondas electromagnéticas que detecta mediante fotorreceptores situados en la retina, en potenciales de acción eléctrica que viajan por el nervio óptico hacia distintas partes del cerebro. Lo que no sabemos es cómo luego, el cerebro construye una imagen mental con esa información. Negar eso en base a las ocurrencias de Heidegger es muy, pero que muy heavy.

David:

No te preocupes porque la Inteligencia Artificial avanza mucho más lento de lo que parece. Creo que no viviremos lo suficiente para tener que huir de despiadados terminators.

Pero sí, uno de los problemas que se plantean es que máquinas sin sentimientos no tienen empatía. Sin embargo, puede solucionarse, al menos parcialmente, si, sencillamente, hacemos que detecten de algún modo nuestro sufrimiento. Un robot podría “verme triste” y preocuparse más por mí que de normal.

Y piensa que también, lo contrario, no garantiza el cumplimiento de las leyes de Asimov. Un robot que siente, siente empatía, pero también odio o envidia. Con sentimientos o sin ellos, los protocolos de Asimov pueden violarse.

Si el cerebro construye una imagen mental incurre en la paradoja señalada por Machado en el Juan de Mairena, que consiste en indicar que una imagen en la conciencia todavía no es la conciencia de una imagen… Esto último, vendría a decir Don Antonio con sus ocurrencias, a ver cómo se explica eléctricamente (y se reproduce en una mente artificial).

Óscar:

El cerebro necesariamente tiene que construir una imagen mental. Que no sepamos muy bien cómo no implica que no la construya. Dime tú si no es el cerebro, de dónde salen las imágenes que tú tienes en tu cabeza cuando recuerdas a Machado. Además, cuando comprobamos empíricamente cada vez con más precisión que hay circuitos neuronales muy concretos que se activan cuando pensamos en diferentes cosas. Entre la inmensidad de experimentos y literatura al respecto, tenemos casos de personas con una parálisis motora total que pueden comunicarse con nosotros mediante un scanner cerebral. Se les hace una pregunta y según la parte del cerebro que se active sabemos si dicen si o si dicen no.

En fin, que yo podría hacerte una cirugía cerebral muy sencilla que, con un pequeño corte, te dejase sin capacidad de habla, sin capacidad de comprender el lenguaje, sin capacidad de crear nuevos recuerdos o, siguiendo tu artículo, sin capacidad alguna de sentir estremecimiento ante vivencia alguna. Además, podría eliminar cada una de estas funciones por separado, sin dañar ninguna de las otras. Algo tendrá entonces que ver el cerebro con tu forma de pensar y sentir, ¿no crees’

Qué duda cabe, doctor Mengele. Ya estaba, de hecho, contemplado en mi mini-artículo. Perdido el órgano, perdida la función. Pero también tenemos esto:

http://sociedad.elpais.com/sociedad/2011/02/24/actualidad/1298502014_850215.html

Y luego está este hombre, que defiende la causa adecuada por las razones más periféricas:

http://www.elconfidencial.com/alma-corazon-vida/2014-11-17/un-cientifico-explica-por-que-importan-mas-las-humanidades-que-la-ciencia_234074/

Lo que quería decir, antes de que hagas de Hannibal Lecter conmigo, es que el acto de conciencia permanece inexplicado por la tecnociencia esta que defiendes, como tú mismo reconoces, mientras que para la filosofía es cosa trillada al menos desde Husserl. Cometéis (ya que escribes en plural), al fin y al cabo, lo que el viejo Aristóteles denominaba una metábasis eis allo genos, o sea, un salto ilegítimo en el marco explicativo. Sencillamente, al igual que no se puede determinar el color correspondiente a una figura geométrica, porque son géneros explicativos diferentes, no se puede tampoco traspasar conceptos de la cibernética para entender estados mentales.

Lo que te ocurre, creo, es que te puede la ciencia-ficción, en el mejor sentido de la palabra. Veo esas fotos escogidas por ti para el artículo y lo entiendo todo: esas recreaciones visuales futuristas enteramente ficticias, con sus puntos refulgentes y tal, pudiera haber quien las tomase por verdaderas fotografías. “¡Eh, tío, mira, en Hypérbole han sacado una neurona!”…

Todo lo que he querido decir en nuestras muchas -e instructivas- discusiones aquí no es que no haya neuronas, sino que eso que nos mostráis, como decía Magritte, no es una jodida neurona.

Sólo una cosa. El responsable de las imágenes fui yo, no Santiago, que no sabía en absoluto las que iba a poner porque de ese texto suyo yo sólo tenía el video del robot.

Y como todas las imágenes que ponemos tienen una cierta relación con el texto, más que nada ilustrativa o estética. Se hace lo que se puede.

Óscar:

Jajaja… Me encantan tus respuestas. Tienes un gran sentido del humor a pesar de estar profundamente equivocado.

Los dos artículos que has subido no tienen relación alguna con nuestro tema. En el primero se habla del largo debate que ha atravesado la psicología del siglo XX acerca de si la inteligencia depende de un solo factor o de muchos. Eso no tiene relación alguna con la teoría modular de la mente, la cual es casi unánimemente aceptada por la comunidad neurológica (también tiene sus detractores y sus matizaciones, como todo). Es decir, una cosa es la competencia con la que uses tus habilidades mentales y otra, muy diferente, si el cerebro tiene diversos módulos funcionales.

El otro artículo, el de mi querido mirmecólogo Edward Wilson, uno de mis mentores intelectuales, está muy bien. Nadie ha dicho que las humanidades no tengan importancia ni puedan ser más o menos importantes que las ciencias. De hecho, Wilson aboga por la famosa consilience o tercera cultura: un continuo entre las ciencias y las letras sin fisuras ni diferenciaciones artificiales. Lo que yo digo es que un filósofo que haga filosofía de la mente o teoría de la percepción sin tener ni pajolera idea del saber científico al respecto, no es ya que se equivoque (que lo hará) sino que se estará perdiendo una cantidad de conocimiento valiosísimo. En fin Óscar, tú te lo pierdes. A mí, no solo me resulta útil, sino apasionante.

Con respecto al error categorial que presupones en el paradigma computacional, se ha hablado muchísimo de ello. La peña no es tonta y no hace falta recurrir a un poeta castellano para tener en cuenta los problemas filosóficos del llamado “teatro cartesiano”. De hecho, por ejemplo, filósofos como Daniel Dennett, critican la noción clásica de representación mental desde una perspectiva puramente computacional. Pero observa lo siguiente:

http://vonneumannmachine.wordpress.com/2009/03/14/la-pantalla-interna-de-nuestro-cerebro/

¿Acojonante no? Una ordenación neuronal con similitudes estructurales con el objeto que pretende representar. ¿Cómo explica esto tu brillante hijo de tonelero? ¿Y cómo alguien puede tener el atrevimiento de hablar de la mente sin tener en cuenta estos descubrimientos?

Y bueno, con respecto a tus presunciones acerca de mi regusto hacia la sci-fi… O sea, cualquier persona que habla del cerebro en términos científicos es un flipao de Star Trek y, lo que es más alucinante, eso produce que invente ficciones cual Julio Verne trasnochado. Seamos serios, por favor.

Yo no entiendo qué miedo os da la ciencia, de verdad. En los dos artículos en los que hemos discutido has sacado el tema del cientificismo. De verdad, la ciencia no muerde, no es mala, es tu amiga. ¡Utilízala!

Lo mismo podria decirte respecto de la filosofía, pero va a parecer que son enemigas, lo cual no es cierto… Ademas no me hace falta: por un sencillo procedimiento natural, que te recomiendo, yo ya he fabricado tres mentes!

Lo mismo podria decirte respecto de la filosofía, pero va a parecer que son enemigas, lo cual no es cierto… Ademas no me hace falta: por un sencillo procedimiento natural, que te recomiendo, yo ya he fabricado tres mentes!

Mis problemas con la tecnología… Escribo por primera vez a través de un teléfono móvil y mira lo que pasa…

Pero pides que seamos serios. Entonces hagámosnos la pregunta seria por antonomasia: ¿esto para qué sirve? El cerebro de un mono dibuja figuras simples (muy simples…), ¿y qué? ¿No debería destinarse el dinero que se gasta en investigación a mejorar los cultivos para acabar con el hambre, o a estudiar enfermedades, o a buscar nuevas fuentes de energía? Si la ciencia son programas de investigación, como decía Lakatos, ¿cuál es la finalidad de la inteligencia artificial? Porque la filosofía resulta mucho más barata… (y aún así la van a liquidar)

Óscar:

Oye, que yo soy filósofo, no científico. Y yo defiendo la filosofía como el que más. Pero es que creo que se hace un flaco favor a nuestra vieja y benerable disciplina oponiéndola a la ciencia. Yo la suelo entender como un montón de conocimiento disponible para que yo lo use como quiera. ¡Es maravilloso acercarse a la biología o a la física desde la filosofía! Tú no sabes lo bien que me lo paso en el huerto de mi suegro, sencillamente, viendo crecer un boniato e intentando comprender profundamente todos los mecanismos biológicos que intervienen en su crecimiento. Y es que, precisamente, creo que eso no está lejos de la filosofía. Me imagino que Aristóteles o Teofrasto harían exactamente lo mismo que yo.

Luego también hay positivistas cerriles que desprecian la filosofía sin saber qué es y, más grave aún, sin saber bien qué es la ciencia. Contra esos sí que hay que luchar, pero yo no soy ni de lejos uno de ellos.

¿Y para que vale la IA? Aparte de las indiscutiples aplicaciones técnicas nos sirve para saber cómo funciona nuestra mente. Si yo, en un ordenador, hago un programa que tiene un manejo competente del lenguaje, en primer lugar tengo que estudiar muy bien qué es el lenguaje y, después, esa simulacion por ordenador me puede dar aún más información. Puedo hacer un montón de experimentos y de pruebas de todo tipo. Si, al final, llegásemos a construir una mente humana computerizada, sería una señal indiscutible de que entendemos lo que es la mente. La utilidad de la IA está fuera de toda duda. Además, también sale barata. Tú puedes hacer muchas cosas, simplemente, desde el ordenador de tu casa. No necesitas un inmenso laboratorio lleno de ratones, hidrógeno líquido y personal de seguridad. Solo necesitas un compilador y aprender a utilizar su lenguaje.

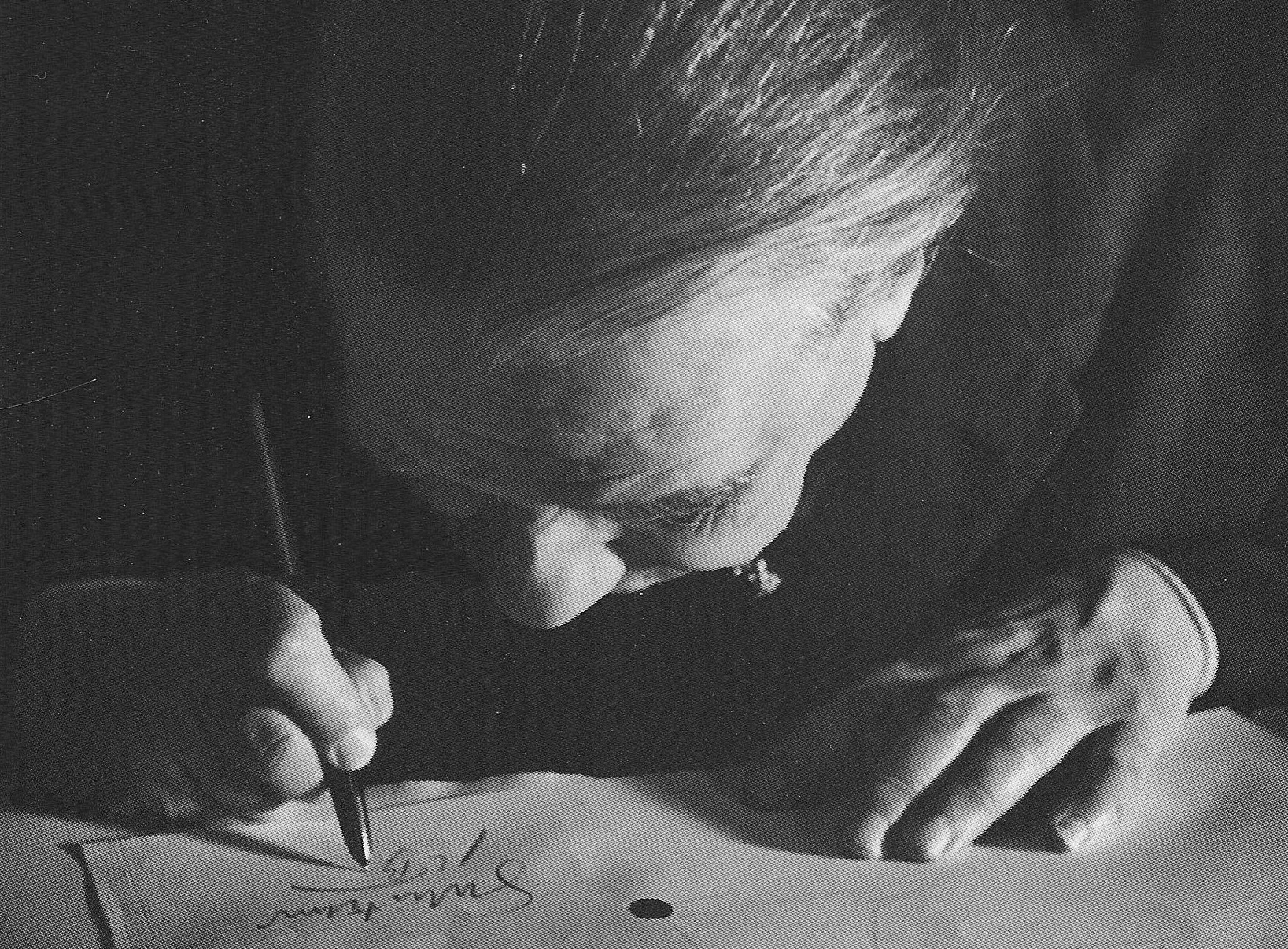

O sea, algo puramente teórico, pura curiosidad, poca cosa… Muy filosófico, sí, a la vieja usanza. Me gusta, pero no sé si es tan serio. ¿Las mentes “funcionan”? ¿Es eso lo que hacen? ¿La mente de Beethoven “funcionaba” mientras componía la Pastoral? Llámame romántico pero todo este lenguaje mecanicista me pone negro, y por eso no nos entendemos, y no porque a mi no me interese la ciencia. Pero la ciencia es una actividad, no la actividad esencial. Y, desde luego, no puede volverse contra nosotros para analizarnos como si fuésemos máquinas. Los ordenadores sólo tienen ¿cuánto? ¿sesenta años? y estamos tan fascinados con su invención que ya creemos que son nuestro espejo, o peor: que nosotros somos su espejo. Prefiero decir que Beethoven se expresaba en la Pastoral, expresando a la vez la sensibilidad de una época. En mi opinión, y no sólo en la mía, si quieres saber cómo funciona una mente, fíjate en el lenguaje. La frase, por ejemplo, “Las chicas buenas van al cielo; las malas, a todas partes”, es de una sofisticación tal que habrá que esperar milenios para que una máquina meramente la entienda, por no hablar ya de concebirla…