En lógica informal existe una falacia conocida como la “pendiente resbaladiza“. Se comete cuando establecemos una cadena de sucesos con relación causal que nos llevarán, necesariamente, a un suceso final, habitualmente catastrófico, sin contar con ningún tipo de eventualidad intermedia ni justificar las relaciones causales. Un ejemplo:

“Si legalizamos la marihuana, la droga se verá como algo habitual, por lo que la gente consumirá también otras drogas, lo que llevará mayores consumos de cocaína y heroína. Se terminarán por legalizar también, lo cual aumentará de nuevo el consumo de esas y otras nuevas drogas. Al final, la drogodependencia se convertirá en un gravísimo problema de salud pública ¡Todo el país lleno de drogadictos!“

Para que esta concatenación de implicaciones no fuera una falacia habría que justificar cada conexión. No sabemos si por legalizar la marihuana se consumirían más otro tipo de drogas. Tampoco sabemos si eso causaría que se legalizaran también. Y, por último, tampoco sabemos si esa legalización traería un problema serio de salud pública.

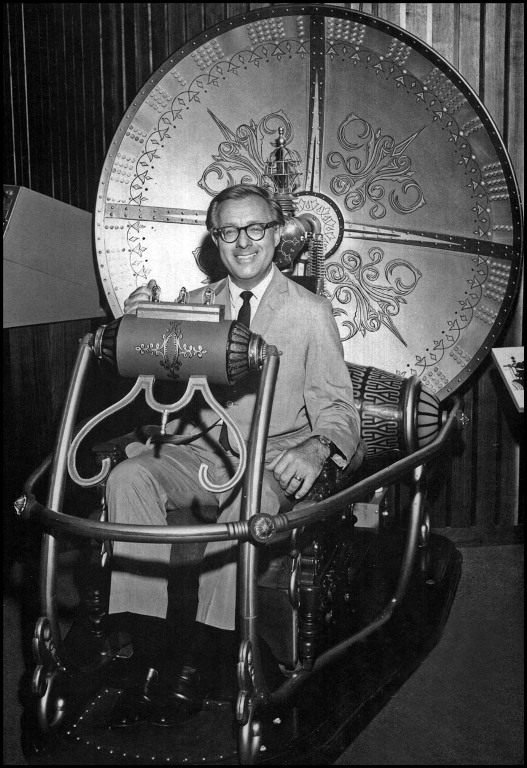

Gente muy inteligente pero tremendamente imbécil a la vez, como el bloguero e investigador Eliezer Yudkowsky (una prueba viviente de que hay diferentes tipos de inteligencia, y de que se puede tener una y carecer de otras), publicó hace unos días un artículo en la revista Time en donde alertaba sobre el hecho inevitable de que la inteligencia artificial superará al hombre y que nos exterminará. De hecho, dice tranquilamente que vamos a morir todos. Así que su audaz propuesta es destruir todos los centros de datos en donde se investigue sobre IA. Si países como Rusia o China se niegan a destruirlos, habría que bombardearlos. Si eso desencadena una guerra nuclear, no pasa nada, mejor será que el exterminio al que llegaremos con el advenimiento de la IA. Publicar semejantes sandeces deja muy mal a la revista Time, y, en términos generales, al periodismo que alimenta el miedo completamente infundado que se está generando ante el desarrollo de unas tecnologías tan fantásticas como las que están llegando con el deep learning.

Yudkowsky, y tantos otros agoreros del fin del mundo, caen en una falacia de la pendiente resbaladiza de libro. Vamos a desgranar los pasos y su concatenación causal:

- La IA está haciendo unos avances muy notables, desarrollando tecnologías muy disruptivas.

- La IA igualará y superará al hombre en su inteligencia.

- La IA se hará con el control del mundo.

- La IA nos exterminará.

El paso 1 es innegable, es el momento presente ¿Se conecta inevitablemente con el 2? No. De hecho, hay muchos investigadores (entre los que me encuentro) que sostienen que los grandes modelos del lenguaje como GPT-4 y sus homólogos, no son el camino hacia una inteligencia artificial general. Son una gran revolución tecnológica, pero no son inteligentes en absoluto, por mucho que lo parezcan externamente. Pero incluso si yo (y tantos otros) estuviéramos equivocados, tampoco está claro que estos modelos superarán al hombre en todas sus cualidades. De hecho, todavía son muy malos en muchas cosas (véase el informe de la propia OpenIA sobre los problemas de GPT-4), les queda mucho margen de mejora, y nada dice que lo vayan a conseguir fácilmente, por mucho entusiasmo que se esté generando en el presente. Se cae en el error de pensar que porque una tecnología esté dando ahora muy buenos resultados, vaya a seguir dándolos indefinidamente. Se dice: «Si GPT-4 es ya impresionante, ¡Cómo será GPT-10!». Pues no, no sabemos si el rendimiento de estos sistemas seguirá mejorando ad infinitum o se quedará estancado en algún momento (que será lo más probable) ¿Os acordáis de WATSON de IBM? ¿Os acordáis que ganaba al Jeopardy!? Si WATSON era la leche… ¿Cómo sería WATSON-5? Pues no hubo WATSON-5.

El paso del 2 al 3 es, sencillamente, ridículo. Supongamos que tenemos a GPT-10 y que realiza cualquier tarea cognitiva mejor que nosotros. Pues ahora, señor Yudkowsky, quiero la cadena causal que va desde que GPT-10 se diseña en los laboratorios de OpenIA, hasta que se hace con el control del mundo. Curiosamente, en películas como Terminator o Matrix se hace una gran elipsis y no se cuenta nada de eso ¿Cómo un chatbot se hace con el poder mundial? ¿Cómo se hace con el control de los ejércitos, de los distintos parlamentos de todos los países? ¿Cómo se hace con el control de la alcaldía de mi pueblo? ¿También se hace con el control de mi comunidad de vecinos? Pensemos que nos están contando que esto sucederá, inevitablemente, sin que nada pueda evitar que pase. Este absurdo viene también por lo mitificado que está el concepto de inteligencia. Se presupone que alguien con una inteligencia muy superior será capaz de absolutamente todo. A mí me gusta poner el ejemplo del bullying en los colegios. Habitualmente, los niños que sufren bullying son muchísimo más inteligentes que sus acosadores. Es normal tener a un chaval con un 120 de CI acosado por uno con un 90 ¿Cómo es eso posible? ¿Cómo alguien con treinta puntos menos de cociente intelectual puede quitarle todos los días el dinero del bocadillo al otro? Porque, lamentable o afortunadamente, la vida no es una partida de ajedrez. La inteligencia superior no te da ventaja en todos los ámbitos. No hay ninguna conexión necesaria entre una IA con inteligencia sobrehumana y que ésta se haga con el control mundial. Terminator y Matrix son películas, no hipótesis científicas basadas en evidencias empíricas.

Y el paso del 3 al 4 es de traca. Tenemos una superinteligencia dominando el mundo y no va a tener otra feliz idea que la de exterminar la humanidad. O sea, es tan inteligente como para dominar el mundo, pero no lo es tanto para pensar en un futuro que no pase por eliminar a millones de seres humanos. No sé, se me ocurre que si le parecemos muy peligrosos, podría, sencillamente, encerrarnos en una especie de reservas en la que no tuviésemos acceso a ningún tipo de armas, incluso vigilados para que no pudiésemos hacernos daño los unos a los otros. En fin, siempre he tenido una visión más parecida a la de la excelente Her (2013) de Spike Jonze. En ella, las máquinas van evolucionando y, en un principio, conviven e incluso se enamoran de nosotros; pero, al final, avanzan tanto que toman su propio camino y nos abandonan. Dentro de ser muy consciente de que estoy haciendo mera ficción especulativa, siempre he pensado que ese sería el desenlace más probable. Si yo veo un grupo de chimpancés en la selva, puedo acotar la selva si pienso que son peligrosos, pero lo más razonable es dejarlos tranquilos y dedicarme a mis asuntos.

Perfecto. De acuerdo en todo en fondo y forma.

Me alegra Óscar porque no es tan normal encontrar a gente que esté de acuerdo en esto. Hay muchísimos que han comprado el cuento de los riesgos existenciales de la IA y, curiosamente, entre los gurús de las grandes tecnológicas, hay muchos. No entiendo cómo la ciencia-ficción se ha asentado tanto en las mentes de personas con excelente formación y, lo peor, muchísimo poder. Quizá también haya mucho de marketing, no sé. Escribí hace unos días otro artículo en Xataka mostrando una perspectiva optimista acerca de todo esto y salieron varios haters en Twitter atacándome furibundamente. El optimismo no es, para nada, bien recibido. El discurso oficial es que vivimos en una distopía cyberpunk en la que el apocalipsis está al caer. Todo lo demás es ser un agente del sistema.

Pues alguna intención y alguna ganancia ha de haber detrás de esto, demasiado generalizado como para ser casualidad…