Yann LeCun citaba un tweet de Benedict Evans que decía así:

“Existe una correlación muy alta entre las personas que piensan que el despegue de la IA es inminente y simple y que dominará el mundo y las personas que expresan regularmente ideas sorprendentemente simplistas sobre cómo funciona el mundo en el que ya vivimos“

Es una gran verdad. Vamos a desarrollarla.

Durante muchísimo tiempo se entendió la inteligencia como una serie de capacidades muy concretas y muy ligadas a lo académico. Por ejemplo, la escala Thurstone de 1920 hablaba de que la inteligencia estaba compuesta por siete habilidades primarias: comprensión y fluidez verbal, comprensión numérica, aptitud espacial, memoria asociativa, velocidad perceptiva y capacidad de razonamiento. Cómo vemos, ser competente en estas habilidades parece garantizarte el éxito académico. Y es que cuando Alfred Binet dio comienzo a la medición de la inteligencia, sus pretensiones eran únicamente disponer de herramientas para analizar o predecir el fracaso escolar. Así, pronto se vio que fuera de esas habilidades académicas, existían otras que quedaban completamente relegadas en los test: las habilidades emocionales estudiadas por John D. Mayer y Peter Salovey, y popularizadas por Daniel Goleman; u otras tantas defendidas en la teoría de Howard Gardner: inteligencia musical, espacial, corporal, interpersonal o intrapersonal. Estos tipos de inteligencia tienen, muchas veces, mucha más relación con el éxito en la vida que la inteligencia puramente académica. Si analizamos nuestras flamantes inteligencias artificiales vemos que adolecen, por completo, de este tipo de inteligencias… Dicho de otro modo: la concepción de inteligencia que suelen manejar los apóstoles de la IA es muy simplona, se reduce a tareas lingüístico-matemáticas, sin tener en cuenta nada más.

El concepto de «inteligencia artificial general» (AGI) a la que, supuestamente, vamos a llegar en tan solo unos años, es harto difuso. Si no tenemos claro qué es la inteligencia, tanto más cuál será la cualidad que la hace general. Es más, de hecho dentro de la psicología hay controversia sobre si la inteligencia es una habilidad general o si solo es una amalgama de habilidades concretas. Si observamos el concepto de cociente intelectual creado por William Stern solo es multiplicar por cien el resultado de la división entre tu edad mental, que surge del promedio de resultados en una serie de pruebas, y tu edad cronológica. El CI es solo un promedio, es decir, no mide una habilidad general. Tener un alto CI solo significa que eres bueno en muchas cosas, no que tengas una cualidad x superior. Entonces, ¿qué quiere decir que vamos a llegar a una AGI? ¿Qué vamos a tener un solo modelo de lenguaje que va a saber hacer muchas cosas diferentes? Pero, ¿cuántas cosas? ¿Qué cosas?

Entonces, esa mal definida y peor comprendida AGI llegará y, es más, se hará a sí misma más inteligente creando una super inteligencia muy por encima del hombre. Los defensores de esta idea no se cortan en sostener que esta nueva entidad nos verá como nosotros vemos ahora a los chimpancés… Y aquí llega el gran riesgo existencial: esa super inteligencia podría tener unos valores éticos no alineados con los nuestros de modo que no tendrá otra idea más peregrina que exterminarnos. Por supuesto, nada podrá pararla, al igual que los pobres chimpancés no podrían detenernos si decidiéramos aniquilarlos. Pero, ¿es esto necesariamente así? Si así fuera Eliezer Yudkowsky no andaría desacertado y habría que empezar a bombardear centros de datos ahora mismo. Muy sorprendente que grandes gurús de la IA hayan pedido ya en dos ocasiones mediante sendas cartas, parones o legislaciones para evitar todo esto. Sam Altman llegó incluso a pedirlo ante un comité del senado de los Estados Unidos. Lo sorprendente es que pidan que se les pare desde fuera… ¿No podrían ellos parar desde dentro? Pero, ¿esto va a ocurrir necesariamente? ¿Existe un riesgo palpable y cercano de que algo así vaya a suceder? Rotundamente no.

Tenemos una pobre definición de inteligencia y aún peor de AGI, tanto menos entendimiento de lo que sería una súper inteligencia artificial que decidiera exterminarnos. Pésimo punto de partida. Pero vamos a analizar ese proceso de automejora que nos llevaría indefectiblemente a la llegada de la súper inteligencia. Permitidme autocitarme en una entrada en mi blog del 2014:

“Pensemos que la humanidad en general no hubiera desarrollado tanto su neocórtex de modo que fuera mucho menos inteligente de lo que es ahora. Imaginemos, por ejemplo, que nos hubiésemos quedado estancados en algún tipo de homo erectus o de ergaster con un CI, pongamos, de 70. Un fastuoso día, el chamán de la tribu se acerca a sus congéneres con una poción mágica cuyo poder reside en hacer más inteligente al individuo que la ingiera. Al tomarla el CI sube de 70 a 80. Podría pensarse, siguiendo a Kurzweil, que si con un CI de 70 pudo fabricarse una poción que nos hacía más inteligentes, con un CI de 80 podría hacerse otra aún más efectiva. ¿Seguro? ¿Por qué 10 puntos de CI son suficientes para diseñar una nueva pócima? Sería posible que las dificultades para elaborar tan maravillosa química requirieran un CI mínimo de 160. ¿Cómo saber cuánto CI hace falta para conseguir la siguiente pócima? Si fuera necesario un 90, nuestros trogloditas estarían condenados a nunca encontrarla ya que se quedarían estancados en el 80 recién adquirido.

Este ejemplo es plenamente aplicable a las inteligencias artificiales. Cuando tengamos una más inteligente que nosotros, ¿por qué iba a poder construir una inteligencia aún más inteligente que ella? A lo mejor las dificultades teóricas, prácticas o de cualquier tipo impiden construir una máquina mejor. La computadora puede no ser lo suficientemente inteligente aún para dar el siguiente paso o, dejémoslo muy claro, simplemente, no se puede. Para que se de un descubrimiento significativo en una rama de la ciencia, hacen falta que se den muchas cosas: nuevas herramientas matemáticas, innovadoras técnicas de observación o experimentación… muchas veces, un descubrimiento es resultado de un trabajo colaborativo de muchas personas e instituciones. Podría pasar que nuestra superinteligencia artificial no pudiera construir otra superinteligencia, sencillamente, porque ningún inversor ve clara la rentabilidad de tal avance. Un nuevo descubrimiento no es solo cuestión de una mayor inteligencia. La máquina analítica de Babagge no pudo construirse no por falta de inteligencia, sino por falta de medios técnicos.“

Ergo, no tenemos evidencia razonable de que un proceso de automejora exponencial que lleve a una súper inteligencia invencible sea de alguna manera factible.

El filósofo chino Yuk Hui sostiene que mantenemos un cierto determinismo tecnológico hacia la llegada de esta superinteligencia, como si solo existiera la posibilidad de un único futuro. Esto me recuerda a la visión antropológica del evolucionismo unilineal de Morgan y Tylor, que defendía que todas las civilizaciones pasaban necesariamente por las fases de salvajismo, barbarie y civilización. El fin de la historia hacia donde todos íbamos estaba, por supuesto, en la Inglaterra del siglo XIX. Esta postura me resulta especialmente curiosa cuando la experiencia histórica en lo referente a la tecnología, y más en los últimos tiempos, es todo lo contrario: domina la impredecibilidad. No se previó el éxito de internet, de las redes sociales, de Youtube, de Twitter… ¿Alguien pensó, tan solo unos años antes de su aparición, que podría existir la profesión de youtuber? ¿Quién vaticinó el éxito de Netflix? ¿Alguien apostaba algo por Amazon cuando solo era una humilde tienda de libros? Curioso: tenemos cisnes negros por doquier pero con respecto de la llegada de la singularidad tecnológica causada por una IA que querrá exterminarnos estamos muy seguros. Aunque ahora nos parezca improbable debido a nuestro entusiasmo, es posible que la IA se queda estancada, es posible que los modelos del lenguaje no avancen mucho más o no puedan resolver los problemas que tienen. A lo mejor llega otra forma de abordar la IA que pase a ponerse de moda y deje relegado al deep learning. Recordemos que las redes neuronales artificiales estuvieron durante muchos años relegadas a un segundo plano en la historia de la informática, y que la propia IA ha pasado por varios inviernos poco fructíferos.

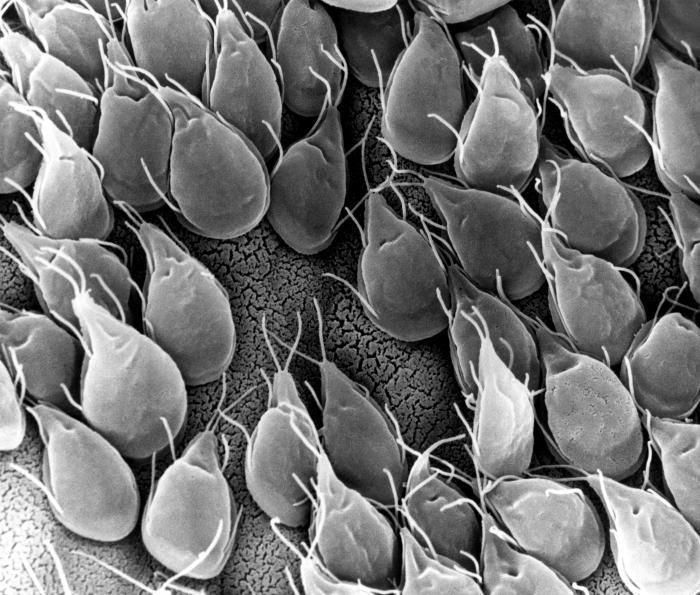

Noam Chomsky, probablemente el lingüista más importante del siglo pasado, sostiene que ChatGPT no es similar a los humanos usando el lenguaje. Los niños no leen millones de textos a partir de los que inducen patrones estadísticos para realizar predicciones. Los niños, con muchísima menos información, consiguen encontrar las causas relevantes de los acontecimientos, consiguen explicaciones y no solo predicciones. Siguiendo a Popper, Chomsky dice que lo interesante de las teorías científicas es que en ellas se realizan predicciones improbables que, contra todo pronóstico, consiguen resistir la prueba experimental. El deep learning es incapaz de la hipótesis perspicaz. Erik J. Larsson, en su muy recomendable El mito de la inteligencia artificial, insiste en las limitaciones del razonamiento puramente inductivo de los LLMs y en su incapacidad de abducción. Judea Pearl, en su algo menos recomendable, Libro del porqué, expresa la necesidad de enseñar razonamiento causal a estos sistemas, ya que carecen completamente de él. Margaret Boden, subraya que las máquinas son incapaces de creatividad transformacional, es decir, que pueden explorar y llevar al límite estilos artísticos ya creados, pero que son incapaces de hacer formas de arte radicalmente nuevas. La razón es que son totalmente ineptos para comprender qué es arte y qué no lo es, adolecen de todo criterio estético. Si miramos en serio sus cualidades, ChatGPT y sus homólogos están todavía lejísimos del pensamiento humano, y me parece muy sorprendente que tantos ingenieros de IA estén tan asustados, más que como una inteligente maniobra de marketing. Y ya no hablemos de emociones o consciencia: por muchas idioteces que se digan, estos modelos carecen por completo de ellas y, aunque uno de los grandes logros de la IA ha sido mostrar que es posible la inteligencia sin consciencia, todavía no sabemos muy bien el papel que juega esta segunda en la primera: ¿y si la consciencia fuera fundamental para realizar ciertas tareas cognitivas?

No quiero parecer chauvinista con respecto al pensamiento humano. Creo que los hombres somos muy torpes y quién sabe si nuestra falta de capacidades sea la responsable de que gran parte de los enigmas del universo permanezcan irresueltos pero, por favor, creo que somos muchísimo más que un modelo de lenguaje que juega a un corta-pega estadístico con millones de tokens, sin comprender absolutamente nada de lo que hace. Lo siento pero me niego aceptar que estos loros estocásticos puedan compararse con nosotros y que sean, además, la causa de un gran optimismo hacia que nuevos modelos nos superen en muy poquitos años. Creo que todavía estamos muy lejos de entender cómo funciona nuestra mente, tanto más para construir una artificial.

Con todo este argumentario no estoy negando tajantemente la posibilidad de que llegara un momento de la historia en que apareciera la susodicha súper inteligencia artificial que terminará por exterminarnos, no se me entienda mal, solo estoy sosteniendo que su posibilidad es, a día de hoy, tan sumamente remota que no debe interceder en nuestra forma de legislar actual. Hacerlo sería algo así como prohibir el cultivo y la venta de setas porque sería posible una rebelión de los hongos tal y como se nos describe en la serie The Last of Us. También habría entonces que comenzar las prevenciones contra un apocalipsis zombi, una rebelión de los simios, invasión extraterrestre, glaciación repentina, muerte temprana del sol… ¡Todo esto también entra en el rango de la posibilidad!

Los LLMs son unos artefactos tecnológicamente fabulosos que, con total seguridad, van a cambiar muchas cosas en nuestra forma de trabajar y de realizar multitud de tareas. También tienen un obvio lado perverso contra el que hay que legislar. Sin embargo, hay que comprenderlos como una gran oportunidad más que como un riesgo existencial. Problemas tan acuciantes como el cambio climático o las crisis de diversa índole que asolan periódicamente nuestras frágiles democracias, pueden ser abordados con IA. Entonces, como bien sostiene Andrew Ng, no hay que parar el desarrollo de la IA, sino que hay que acelerarlo. Dejemos de preocuparnos por fantasías distópicas basadas en relatos de ciencia-ficción, y busquemos y fomentemos el enorme abanico de usos positivos que tiene esta potente tecnología.

Me mola mucho todo lo que argumentas… Pero el problema seguimos siendo nosotros, no estos nuevos chismes. Al igual que Einstein dijo que el armamento nuclear es como poner un hacha en manos de un psicópata, cabe adivininar la enorme cantidad de psicópatas que están tramando como sacarle filo a todo esto…

Fantástico el de Larson, gracias.